OpenAI와 구글을 뛰어넘는다는 메타의 대담한 주장, 과연 라마 4는 AI 시장의 판도를 바꿀 수 있을까요?

안녕하세요. 모두가 주인공 입니다. 요즘 인공지능 시장은 정말 숨 가쁘게 발전하고 있죠? OpenAI의 GPT-4o, 구글의 제미니 2.0에 이어 이번엔 메타(Meta)가 새로운 AI 모델 '라마 4(Llama 4)'를 출시했다는 소식이 전해졌어요. 지난 주말, 저는 AI 개발자 커뮤니티에서 이 소식을 접하고 정말 놀랐답니다. 메타가 이번에 내놓은 모델은 단순한 업그레이드가 아닌, 완전히 새로운 아키텍처를 도입해 성능을 대폭 향상시켰다고 하니 기대가 크네요. 특히 '믹스처 오브 엑스퍼츠(MoE)' 방식을 채택했다는 점이 흥미롭습니다. 오늘은 이 새로운 AI 모델의 특징과 의미에 대해 여러분과 함께 살펴보려고 해요.

목차

라마 4(Llama 4) 모델의 개요와 특징

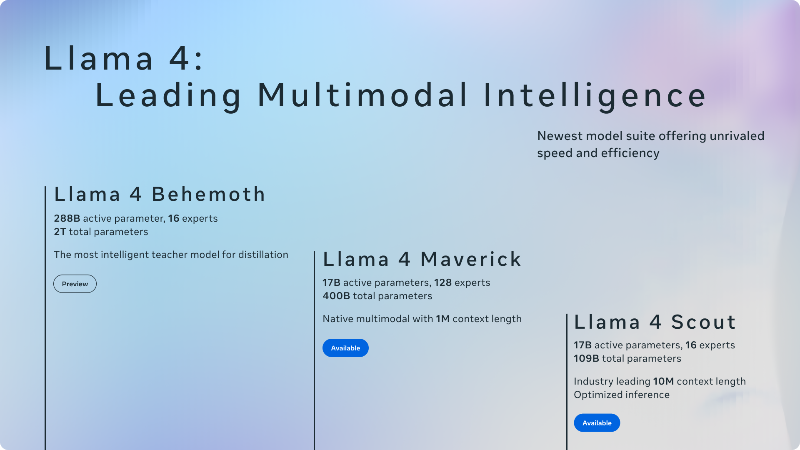

메타가 새롭게 발표한 라마 4 시리즈는 기존 라마 3에서 한 단계 더 도약한 인공지능 모델인데요. 이번에 메타는 세 가지 주요 모델을 발표했어요. 현재 바로 사용 가능한 '라마 4 스카우트(Scout)'와 '라마 4 매버릭(Maverick)', 그리고 아직 훈련 중인 초대형 모델 '라마 4 비히모스(Behemoth)'까지요.

특히 흥미로운 점은 라마 4 스카우트가 이름과는 달리 작은 모델이 아니라는 거에요. 총 1090억 개의 파라미터를 가지고 있으면서도, 단일 NVIDIA H100 GPU에서 작동할 수 있도록 최적화되었다고 하네요. 게다가 무려 1000만 토큰(약 15,000페이지 분량의 텍스트)의 맥락 윈도우(context window)를 지원한다는 점도 놀랍습니다. 한 마디로, 책 수십 권 분량의 정보를 한번에 처리할 수 있다는 거죠!

라마 4 모델들은 모두 텍스트뿐만 아니라 이미지도 함께 처리할 수 있는 멀티모달 기능을 기본적으로 탑재했어요. 물론 출력은 텍스트만 가능하지만, 이미지를 보고 이해하는 능력이 기본으로 내장된 겁니다.

현재 이 모델들은 메타 AI 어시스턴트를 통해 웹과 왓츠앱, 메신저, 인스타그램에서 이미 서비스되고 있으며, 메타나 허깅페이스(Hugging Face)를 통해 직접 다운로드할 수도 있어요. 솔직히 말해서, 오픈소스(라고 주장하는) AI 모델로서는 정말 파격적인 성능을 보여주고 있어요.

라마 4 vs GPT-4o vs 제미니: 성능 비교

메타는 라마 4 모델이 OpenAI의 GPT-4o와 구글의 제미니 2.0 플래시를 "광범위한 벤치마크에서 능가한다"고 주장하고 있어요. 과연 실제로 그럴까요? 각 모델별 주요 스펙과 특징을 비교해 볼게요.

| 모델명 | 총 파라미터 | 액티브 파라미터 | 맥락 윈도우 | 멀티모달 |

|---|---|---|---|---|

| 라마 4 스카우트 | 109B | 17B | 1000만 토큰 | ✓ |

| 라마 4 매버릭 | 400B | 17B | 100만 토큰 | ✓ |

| 라마 4 비히모스(준비중) | 2T | 288B | 미공개 | ✓ |

| GPT-4o | 미공개 | 미공개 | 12만 8천 토큰 | ✓ |

| 제미니 2.0 플래시 | 미공개 | 미공개 | 100만 토큰 | ✓ |

라마 4 스카우트는 구글의 제미나 3과 제미니 2.0 플래시-라이트 모델, 그리고 오픈소스 미스트랄 3.1을 다양한 벤치마크에서 능가한다고 합니다. 매버릭은 OpenAI의 GPT-4o와 구글의 제미니 2.0 플래시와 비교해서도 우수한 성능을 보이며, 코딩과 추론 작업에서는 DeepSeek-V3와 비슷한 결과를 "절반 이하의 액티브 파라미터로" 달성했다고 하네요.

그리고 아직 출시되지 않은 라마 4 비히모스는 2880억 개의 액티브 파라미터와 총 2조 개의 파라미터를 가지고 있으며, 경쟁사의 GPT-4.5와 클로드 소넷 3.7을 "여러 STEM 벤치마크에서 능가할 수 있다"고 메타는 주장하고 있어요. 정말 그런지는... 직접 출시된 후에 확인해봐야겠죠?

MoE 아키텍처: 라마 4의 핵심 기술

라마 4 시리즈의 가장 큰 특징은 "믹스처 오브 엑스퍼츠(Mixture of Experts, MoE)" 아키텍처를 도입했다는 점이에요. 이게 도대체 뭘까요? 쉽게 설명해 볼게요.

MoE는 마치 다양한 전문가로 구성된 팀이 함께 일하는 방식과 비슷해요. 모든 전문가가 모든 작업에 참여하는 대신, 특정 작업에 가장 적합한 전문가들만 선택적으로 활성화되는 구조입니다. 실제 작동 원리는 다음과 같아요:

- 모델 내부에 여러 개의 '전문가 네트워크'(Expert Networks)가 존재해요.

- 각 토큰(단어나 부분 단어)이 처리될 때, 라우터(Router)가 어떤 전문가를 활성화할지 결정합니다.

- 선택된 전문가들만 계산에 참여하고, 나머지는 비활성화 상태로 유지됩니다.

- 이렇게 각 토큰마다 최적의 전문가만 사용함으로써 계산 효율성이 크게 향상됩니다.

- 라마 4 스카우트는 16개의 전문가를 가지고 있으며, 이 중 일부만 선택적으로 활성화됩니다.

이 방식의 가장 큰 장점은 뭐냐면요, 거대한 모델의 능력을 유지하면서도 실제 계산량은 훨씬 적다는 거에요. 일종의 '스마트한 지름길'을 만든 셈이죠. 이게 바로 라마 4 스카우트가 1090억 개의 총 파라미터를 가지고 있으면서도 단일 GPU에서 동작할 수 있는 비결입니다.

MoE 아키텍처는 또한 멀티모달 데이터 처리에도 유리한데, 라마 4에서는 이른바 '얼리 퓨전(early fusion)'을 사용해 텍스트와 이미지를 함께 처리할 수 있도록 했어요. 결과적으로 더 효율적이고 똑똑한 AI 모델이 탄생한 거죠.

한국의 AI 개발 현황과 라마 4의 영향

세계적인 AI 기업들의 경쟁이 치열해지는 가운데, 한국 기업들도 자체 AI 모델 개발에 총력을 기울이고 있어요. 하지만 메타의 라마 4와 같은 초거대 AI 모델이 출시되면서 한국 AI 생태계는 어떤 영향을 받게 될까요?

현재 한국에서는 네이버, KT, 카카오, 삼성 등 주요 기업들이 자체 AI 모델을 개발하고 있어요. 특히 네이버의 '하이퍼클로바 X'는 한국어에 특화된 대형 언어 모델로, 세계에서 세 번째로 공개된 초대형 AI 언어 모델이라는 점에서 의미가 크죠. 그리고 KT는 200억 개의 파라미터를 가진 'Mi:dm'(미듬)을 출시했으며, 삼성전자는 '삼성 가우스2'를 선보였어요.

그런데 말이죠, 메타의 라마 4 같은 초거대 모델이 등장하면서 한국 기업들의 AI 전략에도 변화가 필요해 보여요. 특히 라마 4가 오픈소스(라고 주장하는) 모델로 공개되면서, 한국 기업들 입장에서는 이를 기반으로 한국어에 최적화된 모델을 개발하는 방향으로 전략을 수정할 수도 있을 것 같아요.

이미 카카오는 OpenAI와 협력해 AI 제품을 개발하기로 했고, 업스테이지와 같은 AI 스타트업은 KT와 함께 기업용 LLM 비즈니스를 개발 중이에요. 이런 상황에서 라마 4가 가진 강력한 성능과 개방성은 한국 AI 생태계에 양날의 검이 될 수 있어요.

한편으로는 자체 모델 개발의 필요성이 줄어들 수 있지만, 다른 한편으로는 라마 4를 기반으로 한 한국어 특화 모델 개발이 가속화될 가능성도 있어요. 가령 한국어 데이터로 라마 4를 파인튜닝하거나, MoE 아키텍처를 활용해 한국어에 최적화된 모델을 만드는 등의 접근이 가능하겠죠.

오픈소스? 라마 4의 라이선스 이슈와 논쟁

메타는 라마 시리즈를 "오픈소스"라고 홍보하고 있지만, 실제로는 몇 가지 중요한 제한 사항이 있어요. 이 부분은 기업이나 개발자들이 라마 4를 활용할 때 반드시 알아두어야 할 내용이랍니다.

라마 4 라이선스의 주요 제한 사항과 관련 논쟁을 살펴볼게요:

| 쟁점 | 라마 4 라이선스 내용 | 오픈소스 이니셔티브(OSI) 입장 |

|---|---|---|

| 사용자 제한 | 월간 활성 사용자가 7억 명 이상인 기업은 사용 전 메타의 허가 필요 | 특정 그룹 차별 금지 원칙(OSD 5항) 위반 |

| 상업적 이용 | 일부 상업적 이용에 제한 존재 | 사용 분야 제한 금지 원칙(OSD 6항) 위반 |

| 용어 사용 | 메타는 라마 4를 "오픈소스"로 표현 | "오픈워싱(openwashing)"이라고 비판 |

| 메타의 입장 | AI 발전을 위해 연구 결과 공유 필요 | 오픈소스 정의를 자신들의 이익에 맞게 변경하려는 시도 |

| 실질적 영향 | 대부분의 기업과 개발자는 제약 없이 사용 가능 | 원칙의 문제로 오픈소스로 인정하지 않음 |

솔직히 말해서, 메타의 라이선스는 순수한 오픈소스와는 거리가 있어요. 하지만 현실적으로 월간 활성 사용자 7억 명 이상인 기업은 소수에 불과하기 때문에, 대부분의 개발자와 기업은 라마 4를 자유롭게 활용할 수 있을 겁니다.

이런 라이선스 논쟁은 AI 모델의 공개와 상업적 이익 사이의 균형점을 찾는 과정에서 발생하는 성장통이라고 볼 수도 있겠네요. 앞으로 AI 모델을 위한 새로운 라이선스 형태나 오픈소스 정의의 변화도 있을 수 있을 것 같아요.

AI 생태계의 미래와 라마 4의 영향력

라마 4의 출시는 단순한 새 모델의 등장을 넘어, AI 생태계 전반에 다양한 영향을 미칠 것으로 예상돼요. 특히 MoE 아키텍처의 도입, 초장문 맥락 윈도우 지원, 그리고 준오픈소스 정책은 앞으로 AI 분야에 어떤 변화를 가져올까요?

라마 4가 AI 생태계에 미칠 잠재적 영향을 살펴볼게요:

- 모델 아키텍처 변화: MoE 방식이 새로운 표준이 될 가능성이 커요. 이는 더 효율적인 AI 모델 개발로 이어질 수 있습니다.

- 컴퓨팅 자원 접근성: 단일 GPU에서도 작동하는 모델 설계로 AI 개발 민주화에 기여할 수 있어요.

- 맥락 윈도우 경쟁: 1000만 토큰의 맥락 윈도우는 장문 콘텐츠 처리와 분석 분야에 혁신을 가져올 수 있습니다.

- 오픈소스 생태계: 제한적이나마 공개된 모델은 연구와 응용 분야에서 다양한 혁신을 촉진할 거에요.

- 다양한 언어 최적화: 라마 4를 기반으로 한국어, 일본어 등 다양한 언어에 최적화된 모델이 등장할 수 있습니다.

- AI 기술 발전 가속화: 메타와 경쟁사들 간의 경쟁이 더욱 치열해지면서 AI 기술 발전이 더욱 빨라질 것으로 예상됩니다.

- 비즈니스 모델 변화: 기업들은 모델 자체보다 특화된 서비스와 응용 프로그램으로 경쟁하게 될 수 있어요.

특히 메타가 4월 29일 개최 예정인 LlamaCon 컨퍼런스에서 AI 모델과 제품에 대한 향후 계획을 논의할 예정이라고 하니, 여기서 또 어떤 놀라운 발표가 있을지 기대가 되네요!

결국 라마 4의 등장은 AI 기술의 발전 방향과 속도, 그리고 접근성에 상당한 영향을 미칠 것으로 보입니다. 메타의 이러한 움직임이 실제로 AI 민주화에 얼마나 기여할지, 그리고 오픈소스 개념이 AI 시대에 어떻게 재정의될지 계속 지켜볼 필요가 있어요.

자주 묻는 질문 (FAQ)

맺음말: AI 경쟁의 새로운 지평

오늘 살펴본 메타의 라마 4 모델은 단순한 기능 업그레이드가 아니라, AI 아키텍처의 패러다임을 바꾸는 중요한 전환점이 될 수도 있을 것 같아요. MoE 구조와 초장문 맥락 윈도우는 분명 인상적인 기술적 진보입니다. 메타가 이렇게 적극적으로 모델을 공개하는 방식은 AI 기술의 민주화에 기여하면서도, 동시에 구글과 OpenAI 같은 경쟁자들에게도 기술 혁신의 압박을 가하고 있어요.

솔직히 말해서, 모든 기업이 자신만의 기초 모델을 처음부터 개발할 필요는 없을지도 몰라요. 메타처럼 강력한 기초 모델을 공개하고, 각 기업과 개발자들은 자신들의 특화된 영역에 맞게 이를 최적화하는 방향으로 AI 생태계가 발전한다면, 더 빠른 혁신과 다양한 응용이 가능해질 거에요. 한국 기업들도 이런 흐름에 주목하고, 자체 모델 개발과 함께 공개 모델의 효과적인 활용 전략도 함께 고민해야 할 시점인 것 같습니다.

여러분은 라마 4에 대해 어떻게 생각하시나요? 실제로 사용해보셨거나, 특정 분야에 적용해볼 계획이 있으신가요? 아니면 다른 모델이 더 마음에 드시나요? 댓글로 여러분의 생각을 공유해주세요! 라마 4와 관련해 더 알고 싶은 점이 있으시면 질문도 환영합니다. 다음 포스팅에서는 라마 4를 활용한 실제 응용 사례와 튜토리얼을 준비해볼까 해요. 많은 관심 부탁드립니다!

태그:

출처:

- - Meta 공식 발표자료 (2025년 4월)

- - The Verge, "Meta releases two Llama 4 AI models" (2025.04.06)

- - TechCrunch, "Meta releases Llama 4, a new crop of flagship AI models" (2025.04.05)

- - VentureBeat, "Meta's answer to DeepSeek is here: Llama 4 launches with long context Scout and Maverick models" (2025.04)

- - Open Source Initiative, "Meta's LLaMa license is still not Open Source" (2024)